Development Tools für ADAS Design

Automotive Technologie Lösungen

Die Bildverarbeitung hat durch Deep Learning einen regelrechten Sprung in der Qualität als auch in der Robustheit erreicht. Somit können heute Objekterkennungen in Echtzeit durchgeführt werden. Unsere Technologie der Objekterkennung und Klassifizierung ermöglicht neue Anwendungsfälle für Fahrassistenzsysteme und autonomes Fahren.

Die Zukunft für Entwicklung von ADAS Use-Cases: Das vortrainierte EYYESNET oder Neuentwicklung durch unser optimiertes CNN Development & Training.

EYYESNET

Das EYYESNET ist ein neuronales Netz für die visuelle Objekterkennung aus Bildern, das die wichtigsten verkehrsbezogenen Klassen (Person, Fahrrad/Motorrad, Auto, LKW/Bus, Zug/Straßenbahn) für Lösungen im Automobil- und Bahnbereich abdeckt. Die Netzwerkarchitektur wurde für hohe Präzision und geringen Leistungsverbrauch optimiert, speziell für die Verwendung auf embedded Plattformen.

EYYESNET kann mit herkömmlichen KI-Inferenzmaschinen oder mit der leistungsstarken EYYES Layer Processing Unit verwendet werden. In einem 5-jährigen Trainingsprozess wurde mehr als 5 PB an realen Bilddaten sowie zusätzlich mehr als 10 PB an synthetischen Daten für unterschiedlichste Wetter- und Umgebungsbedingungen verwendet. Die laufende Weiterentwicklung und das Training des Netzes für weitere Anwendungen, Objekte und Umgebungsbedingungen, sichert den Anwendern unseres EYYESNET die stetige Verbesserung ihrer Anwendungen und Lösungen.

Erkennung von:

• Fußgängern (Erwachsene, Kinder, …)

• Radfahrern

• Rollstuhlfahrern

• Autos

• Lastwagen

• Züge

• Ampelsignalen

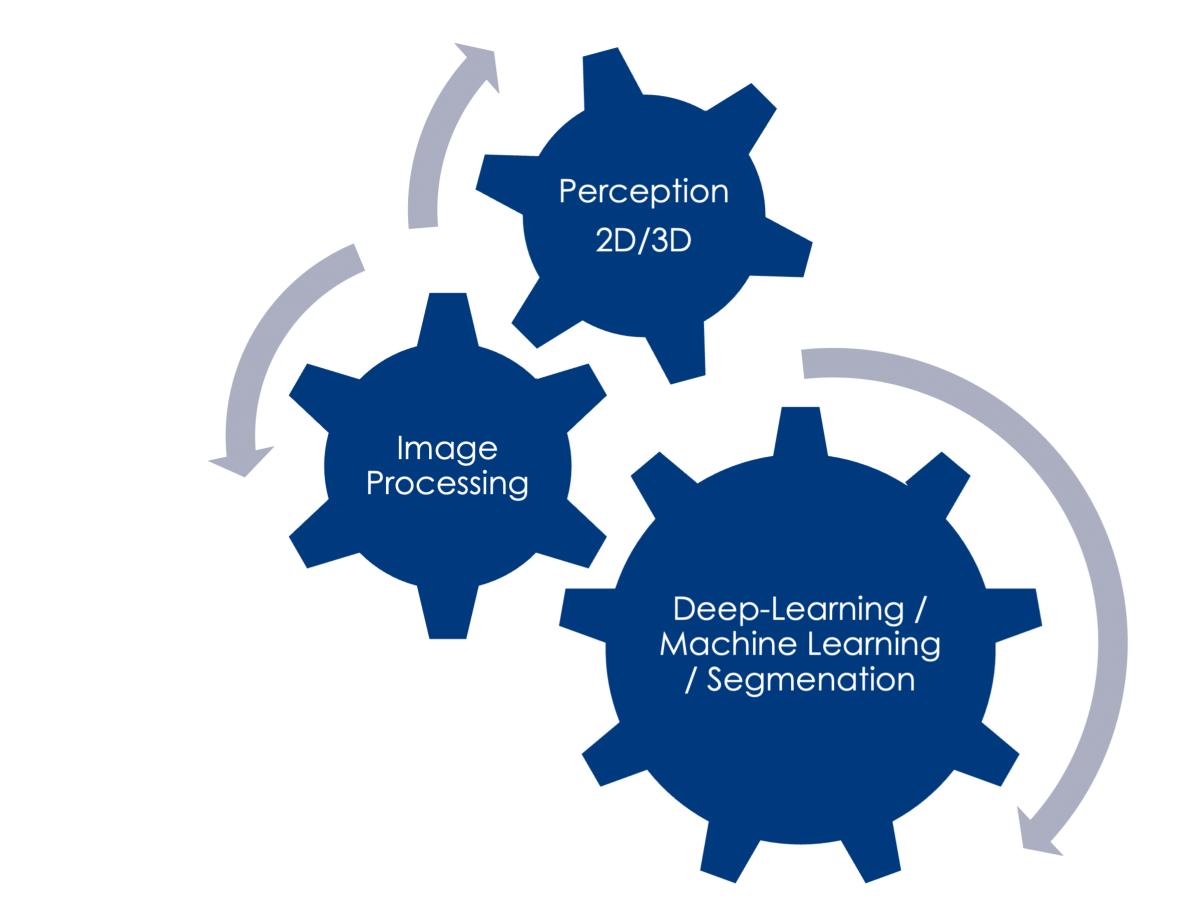

Software Framework

Mit dem modularen Software Framework von EYYES ist es in kurzer Zeit möglich, Prototypen für Videoverarbeitungssysteme umzusetzen. Enthalten sind Module für Deep Learning, in denen das EYYESNET oder andere neuronale Netze eingesetzt werden können. Diese Module können beliebig verknüpft und parametriert werden. Damit kann ein breites Spektrum unterschiedlichster Anwendungen des Frameworks dargestellt werden.

• Erfassung der Umgebung mittels 2D-3D Estimation

• Bildverarbeitungspipeline für Größenänderung, Drehung, Verbesserung, Aufnahme & Morphologie

• CNN-Berechnung und Segmentierung

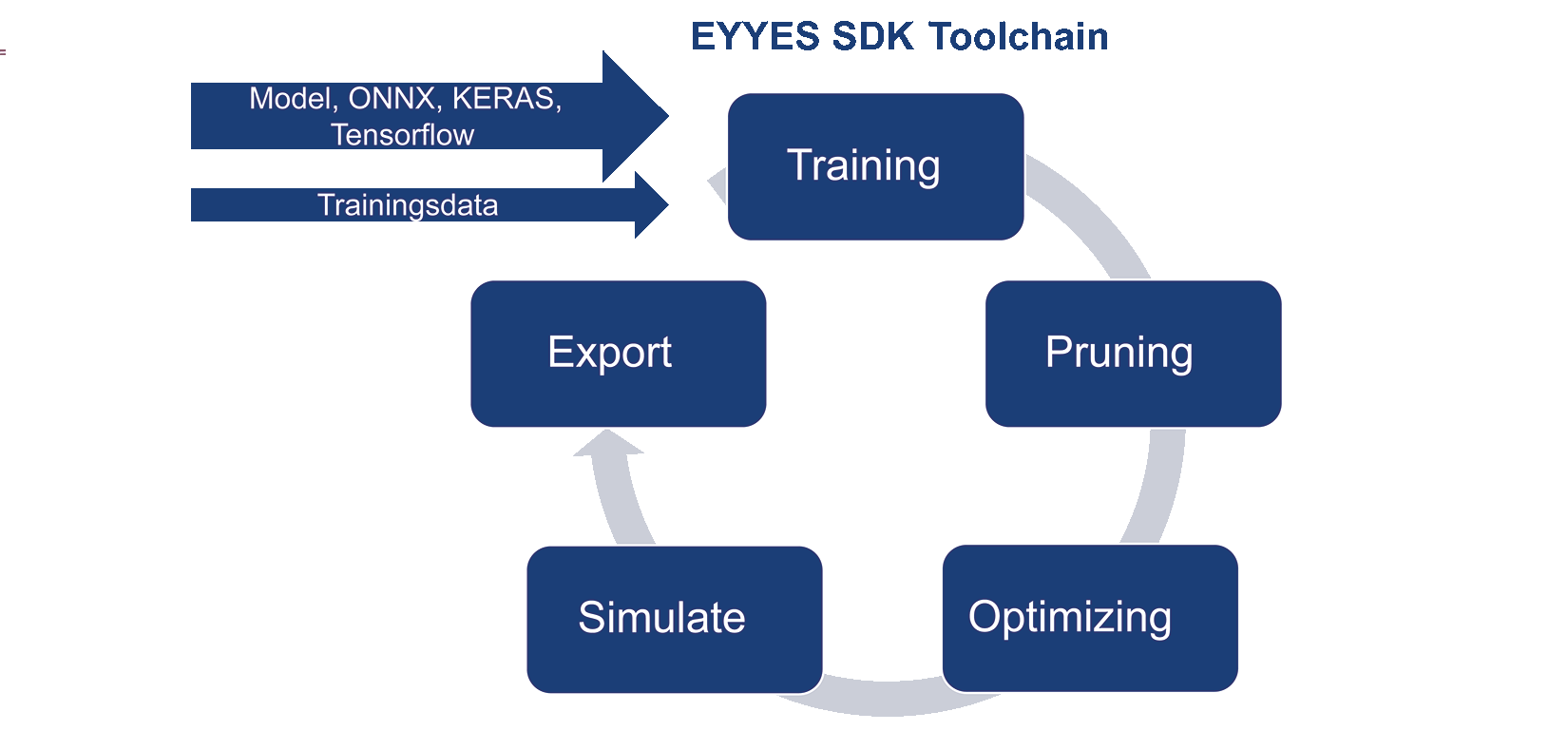

CNN Optimierung

Mit der CNN Optimierung ist es möglich, bestehende Daten um den Faktor von bis zu 40 zu reduzieren, ohne die Qualität der Ergebnisse zu beeinträchtigen. Dieser Service kann individuell eingesetzt werden und ist nicht an einen Netzwerktyp gebunden. Die nahezu verlustfreie Verkleinerung des Netzes ermöglicht es, komplexe Aufgaben in einem eingebetteten System zu lösen.

Kontaktieren Sie uns!